Fachforum: Wissen bewahren - Fachkräfte binden. Digitale Tools für die Praxis

Wissen bewahren, Fachkräfte binden: Unser Fachforum am 18. März im Transferort Wittenberge zeigte praxisnah, wie der regionale …

Der Hype um Künstliche Intelligenz ist verbunden mit einem sehr hohen Qualitätsversprechen, ganz nach dem Motto: Die KI kann alles schneller und besser als der Mensch und macht keine Fehler. Doch weit gefehlt! Am Beispiel von KI-Chatbots zeigt sich, dass diese, auch wenn sie über eine gute Datenbasis verfügen, Fehler machen können. Das hat u.a. mit den statistischen Wahrscheinlichkeiten zu tun, mit denen der KI-Chatbot seine Antworten berechnet. Der Beitrag erläutert verständlich, warum KI-Systeme Fehler machen und wie Nutzer*innen damit umgehen können.

Unser KI-Chatbot-Prototyp basiert auf einem Sprachmodell. Ein Sprachmodell ist ein mathematisches und statistisches Modell („künstliche Intelligenz“), das darauf trainiert ist, natürliche Sprache zu verstehen, zu erzeugen oder zu bearbeiten. Sprachmodelle sind Computerprogramme mit der Fähigkeit, die Wahrscheinlichkeit einer Wortfolge vorherzusagen. Daher können sie gut Texte vervollständigen, übersetzen, Sprache erkennen und Text erzeugen [1]. Im Kern funktioniert das System ähnlich wie eine sehr fortgeschrittene Textergänzung: Es analysiert die Worte Ihrer Frage und berechnet, welche Wörter als Antwort am wahrscheinlichsten zusammenpassen.

Da Sprachmodelle also keine Wahrheiten, sondern nur Wahrscheinlichkeiten berechnen können, besteht immer die Gefahr von falschen Antworten. Wenn die „künstliche Intelligenz“ falsche, unlogische oder frei erfundene Antworten generiert und sie als Fakten präsentiert, spricht man von Halluzinationen (siehe auch Absatz unten).

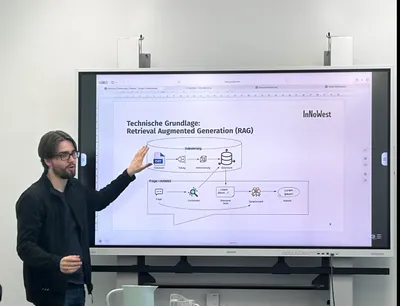

Im Gegensatz zu allgemeinen Chatbots wie „ChatGPT“, „Le Chat“ oder „Chat AI“, welche früher hauptsächlich auf ihr antrainiertes, internes Wissen vertraut haben, besitzt der InNoWest-KI-Chatbot einen zusätzlichen Schutzmechanismus, um Halluzinationen zu vermeiden. Bevor eine Antwort generiert wird, durchsucht das Sprachmodell gezielt die Webseite einer Kommune (z.B. Landkreis Uckermark, Landkreis Oder-Spree, Stadt Velten) nach relevanten Inhalten. Dieses Verfahren nennt sich „Retrieval-Augmented Generation” (RAG). Das bedeutet vereinfacht gesagt: Der KI-Chatbot schlägt gezielt Informationen nach, anstatt sich nur auf sein „Gedächtnis”, also das allgemeine Sprachmodell zu verlassen.

Zusätzlich wird das InNoWest-System auf vertrauenswürdige Domains beschränkt. Das Sprachmodell bezieht seine Informationen ausschließlich aus offiziellen kommunalen Quellen, die die jeweilige Kommune selbst ausgewählt hat. Der KI-Chatbot kann somit nicht auf alle beliebige Internetseiten zugreifen. Wichtig zu verstehen: Trotz dieser Schutzmaßnahmen kann auch der InNoWest-KI-Chatbot Fehler machen. Kein KI-System ist unfehlbar. Im Folgenden erklären wir, welche Fehler auftreten können und wie Sie damit umgehen können.

Der häufigste Sprachmodell-Fehler trägt einen ungewöhnlichen Namen: Halluzination. Dabei erzeugt das Sprachmodell Informationen, die überzeugend klingen, aber sachlich falsch sind. Das Tückische: Das Sprachmodell formuliert diese erfundenen Fakten mit derselben Überzeugung wie korrekte Informationen. Es ist daher für eine Nutzer*in kaum ersichtlich, ob es sich um einen Fakt oder eine Halluzination handelt.

Bekanntes Beispiel: 2023 reichte ein Anwalt in New York einen Antrag ein, der auf ChatGPT-Recherche basierte. Die genannten Gerichtsurteile und Aktenzeichen waren vollständig erfunden – das Sprachmodell hatte sie „halluziniert”.

Sprachmodelle werden zu einem bestimmten Zeitpunkt trainiert. Informationen, die nach diesem Zeitpunkt entstanden sind, kennt es daher zunächst nicht. Öffnungszeiten, Ansprechpartner oder Regelungen können sich aber geändert haben. Auch Chatbots, die wie der InNoWest-KI-Chatbot, über Webseiten auf stets aktuelle Informationen zugreifen können, machen manchmal diesen Fehler. Zum Beispiel wenn er unterschiedliche Informationen zu Öffnungszeiten oder Ansprechpartner*innen auf der Webseite findet. Das Modell kann dann nur „raten“, welche Information aktuell ist.

Manchmal fasst das Sprachmodell Informationen zu stark zusammen und lässt dabei wichtige Einschränkungen oder Details weg. Was für einen Spezialfall gilt, wird dann fälschlich als allgemeine Regel dargestellt. Dies ist insbesondere schwierig, wenn es um rechtliche Einschätzungen geht. Recht ist komplex und kennt viele Ausnahmen und Bedingungen, die Sprachmodelle nicht oder nur schlecht erfassen können.

Die Trainingsdaten eines Sprachmodells spiegeln die Inhalte wider, aus denen es gelernt hat. Sind diese Daten unausgewogen, kann auch das Sprachmodell unausgewogene Antworten geben.

Ein Sprachmodell besitzt kein Wissen im menschlichen Sinne. Es erkennt Muster in Texten und berechnet, welche Wortfolgen statistisch wahrscheinlich sind. Wenn Sie eine Frage stellen, sucht die KI nicht in einer Datenbank nach der Antwort, sondern sie erzeugt eine neue Textfolge, die (wahrscheinlich) zu Ihrer Frage passt. Stellen Sie sich das so vor: Die KI spielt ständig das Spiel „Vervollständige den Satz” – nur auf einem extrem hohen Niveau. Sie weiß aber nicht, ob das Ergebnis tatsächlich stimmt.

Sprachmodelle wurden so trainiert, dass sie möglichst hilfreiche Antworten geben. Leider führt das dazu, dass sie selten „Ich weiß es nicht” sagen, auch wenn das die ehrliche Antwort wäre. Forschende bei OpenAI haben festgestellt [2], dass die Art, wie KI-Systeme während des Trainingsprozesses bewertet werden, das Raten belohnt und Zurückhaltung bestraft. Um das zu vermeiden, haben wir dem InNoWest-KI-Chatbot die Anweisung gegeben, dass er im Zweifelsfall sagt, dass er an dieser Stelle nicht weiterhelfen kann. Anweisungen dieser Art kann man über den allgemeinen Systemprompt geben, wobei auch Fehler weiter nicht zu 100 % ausgeschlossen werden können.

Kein Trainingsdatensatz ist vollständig. Wo Informationen fehlen oder widersprüchlich sind, kann die KI falsche Schlüsse ziehen. Das „Misinformation Review“ der Harvard Kennedy School [3] beschreibt diese Datenlücken als eine Hauptquelle für KI-Ungenauigkeiten und Halluzinationen.

Verlassen Sie sich nie allein auf die KI-Antwort. Prüfen Sie wichtige Informationen bei offiziellen Quellen nach wie etwa der Gemeindewebsite, dem Landratsamt oder Fachbehörden [4, 5]. Der InNoWest-KI-Chatbot gibt nach Möglichkeit Links zu seinen Quellen an. Folgen Sie diesen Links und prüfen Sie, ob die Originalquelle tatsächlich das aussagt, was der Chatbot für Sie zusammengefasst hat.

Seien Sie besonders aufmerksam bei konkreten Zahlen und Statistiken, Namen von Ansprechpersonen, Öffnungszeiten und Fristen sowie rechtlichen Aussagen und prüfen Sie diese auf der Originalwebseite noch einmal nach.

Der Chatbot ist ein nutzer*innenfreundliches Informationsangebot, jedoch leider kein Ersatz für offizielle Auskünfte. Bei rechtlichen, finanziellen oder gesundheitlichen Fragen wenden Sie sich bitte immer an die offiziell zuständige Stelle.

Im Laufe der Zeit werden Anwender*innen und Betreiber*innen immer besser herausfinden, in welchen Szenarien die Nutzung von KI-Chatbots die meisten Vorteile bringt. In besonders wichtigen und dringenden Fällen, wird es jedoch weiterhin die beste Option sein, sich an menschliche Ansprechpartner*innen in Ihrer Kommune zu wenden. Auch im Hinblick auf den Ressourcenverbrauch der Sprachmodelle ist es ratsam, nicht jedes allgemeine Problem und jede Frage mit einem KI-Chatbot zu diskutieren. Er kann jedoch unterstützen, relevante Informationen auf der kommunalen Webseite schneller zu finden und Ihnen somit einen Anruf oder auch einen Weg zum Amt zu sparen.

KI-Chatbots sind nützliche Werkzeuge, aber keine unfehlbaren Experten. Sie können schnell Orientierung bieten und auf relevante Informationen hinweisen, die finale Verifizierung und somit auch Verantwortung liegt jedoch bei Ihnen als Nutzer*innen. Mit einer gesunden Portion Skepsis und der Bereitschaft, wichtige Aussagen zu prüfen, können Sie die Vorteile der Technologie nutzen und das Risiko von Halluzinationen zu mindern.

Bei der Erstellung dieses Beitrags kamen - insbesondere im Hinblick auf Lesbarkeit und Verständlichkeit - sowohl künstliche als auch menschliche Intelligenz zum Einsatz.

Regionale Vernetzung für Wissensaustausch

Data Processing

Data Engineering

Wissen bewahren, Fachkräfte binden: Unser Fachforum am 18. März im Transferort Wittenberge zeigte praxisnah, wie der regionale …

Das Team Digitalisierung mit Dr. Josephine Jahn, Marvin Prigenitz und Dorian Zwanzig präsentierte am 29. Januar 2026 im Transferort Wittenberge ein …